AI伺服器前景续旺 北美CSP、中国双轨、本土OEM成三大动能

龚明德表示,全球AI伺服器在2023~2024年年增逾4成,从2023~2029年来看,AI伺服器出货年复合成长率可达23%,到2029年在整体伺服器出货占比将突破24%。同时,一般伺服器需求也逐步回升,2024年出货年增率上修至7.6%,2025年有机会超过9%,AI带动传统IT投资回暖,AI伺服器也从选配,正式成为资料中心的标准基础建设。

他说明,全球AI需求由目前三大客群驱动:北美五大CSP(Microsoft、Amazon、Google、Meta、Oracle)、中国云端业者,以及品牌伺服器OEM。其中又以北美五大CSP最具影响力,在大型语言模型与生成式AI竞赛下持续大幅提高资本支出,使AI伺服器快速成为资料中心的标配。

相较之下,中国市场在美中科技战与出口管制下走向「国际方案+本土方案」双轨路线。BAT等原本依赖高阶GPU的企业,在H20受限后转向自研ASIC或本土GPU,使中国AI供应生态逐渐与全球市场分化。

品牌OEM同样受惠整体IT投资回升。龚明德指出,Dell今年出货最为亮眼,HP则受主权云计划与Tier-2资料中心需求增温而同步回温,带动企业级伺服器需求全面走扬。

GPU霸权持续!辉达掌握CoWoS产能 台厂三雄成大赢家

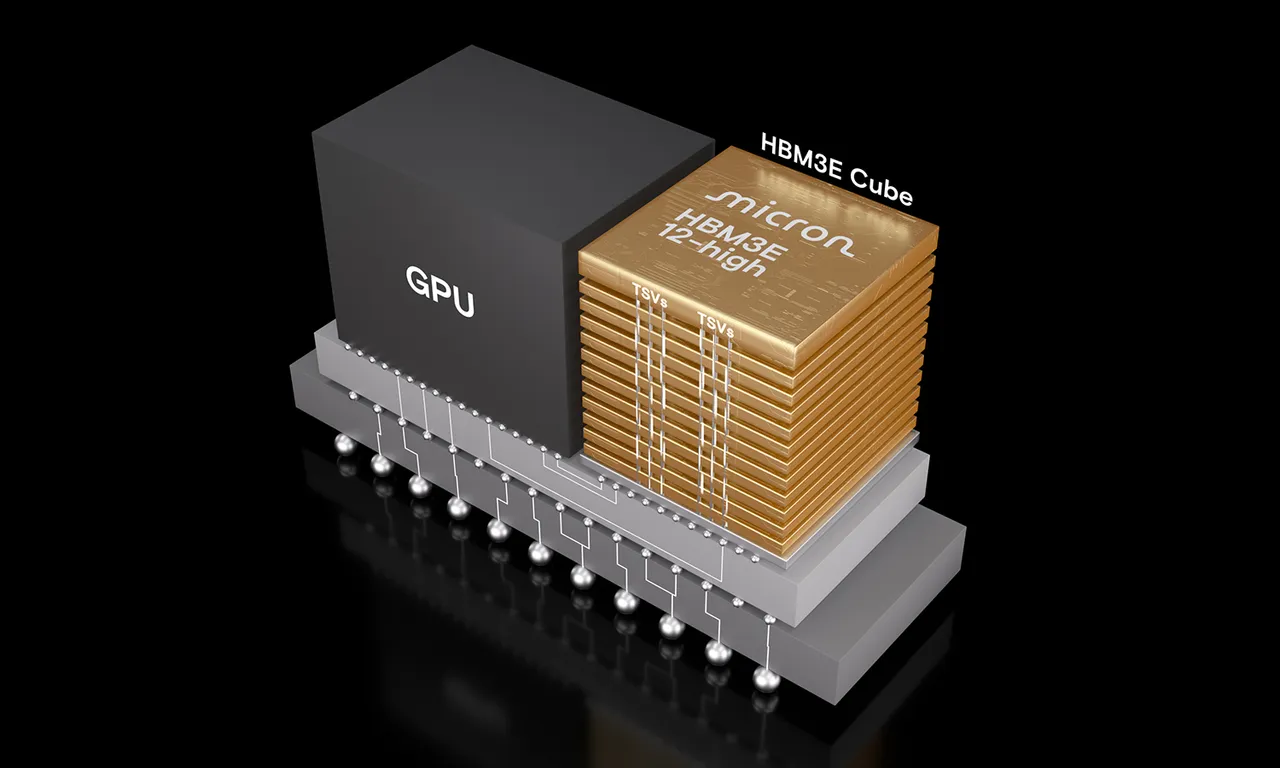

在算力供给端,GPU仍是市场主轴,自研ASIC与FPGA仅为辅助角色。其中高阶GPU几乎由NVIDIA垄断,其H系列、B系列与GB系列产品全面仰赖台积电CoWoS与HBM堆叠技术,形成极高供应门槛。TrendForce预估,Blackwell将推升台积电CoWoS于2025年产能大增至60万片、年增九成,2026年再增7成;2025年NVIDIA一家公司便将吃下约6成CoWoS产能,2026年即便Broadcom等ASIC放量,仍难撼动其主导地位。

在出货层面,2024年NVIDIA高阶GPU出货约590万颗,受H20限制略有下修,但2025年仍可达690~700万颗。AMD MI系列将从今年60万颗提升至明年的70万颗以上,MI400更将以整柜机型对决NVIDIA VR系列;Intel则在高阶GPU市场动能偏弱。

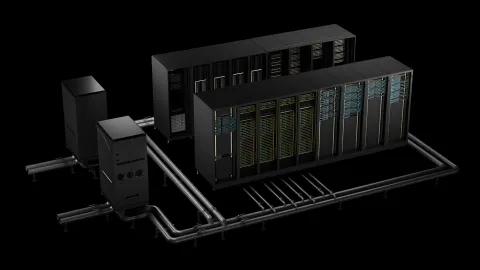

算力需求的持续拉升,也让AI伺服器架构快速转向整柜部署,GB Rack成为新焦点。GB200为今年主力,GB300将于第四季开始出货并于明年放量。TrendForce预估,2025年GB Rack出货达3.6万柜,2026年将增至5.9万柜,成长速度远超整体伺服器市场,其中,8成以上来自北美五大CSP,Oracle与Microsoft增速最快。

整柜化浪潮也让台厂成为最大受惠者。鸿海、广达、纬创承接GB主力机柜订单;英业达、美超微、技嘉则聚焦H100S八卡机与部分客制化案。由于整柜AI产品单价可上看350万美元,台厂AI伺服器营收占比快速走高,广达今年AI占比达7成,明年更有望突破8成。

自研ASIC崛起+中国AI晶片本土化 华为量能2026挑战百万颗

非GPU势力也在快速壮大。Google TPU、AWS Trainium/Inferentia持续演进,Meta MTIA与Microsoft Maia系列加速追赶,使自研ASIC在AI运算晶片中的占比推升。TrendForce预估,自研ASIC占比2025年将升至25%,2030年前后有望逼近40%。

中国AI生态受出口管制影响剧变。H20受限后外购GPU占比明年恐降至三成,本土GPU+ASIC加上中国CSP自研晶片市占已逾4成,未来突破5成并非难事。华为与寒武纪是最大动能,华为2025~2026年AI晶片出货更有望挑战百万颗规模,成为成长最快速的AI晶片势力。

CoWoS与HBM仍是瓶颈 地缘政治成最大变数

他提醒,无论是GPU或自研ASIC,最终都绕不开CoWoS与HBM这两大核心瓶颈。HBM从HBM3e迈向HBM4,三星、SK海力士、美光三大记忆体原厂近年大幅集中投资,让供需长期呈现紧俏,未来恐成推升AI伺服器成本与压缩毛利的最关键变数。

龚明德总结,虽然一般伺服器需求已回升,AI伺服器仍维持逾两成的年增率,北美CSP将是推动市场的核心力量,2028~2029年后Edge AI推论也可能带来新一波成长动能;然而,美国大选后科技管制、出口政策与关税走向,仍将决定2026年后全球AI伺服器与半导体供应链的最大不确定性。

點擊閱讀下一則新聞

點擊閱讀下一則新聞